[2026 Predictions Webinar] How to Build an AI-Ready Data Architecture This Year | Register Now

ANWENDUNGSFALL | SHIFT-LEFT ANALYTICS

Weniger Datenbereinigung. Mehr Entwicklung.

|Bereit, die unnötige Datenvermehrung und manuelle Fehlerbehebung in Daten-Pipelines zu beenden? Daten an der Quelle mit einer Daten-Streaming-Plattform verarbeiten und verwalten – innerhalb von Millisekunden nach ihrer Erstellung.

Durch die Vorverlagerung der Verarbeitung und Governance können Probleme mit der Datenqualität um bis zu 60 % reduziert, die Rechenkosten um 30 % gesenkt und die Produktivität der Entwickler sowie der ROI des Data-Warehouse maximiert werden. Jetzt weitere Ressourcen für den Einstieg entdecken oder Shift Left: Unifying Operations and Analytics With Data Products herunterladen.

Why Shift Processing & Governance Left?

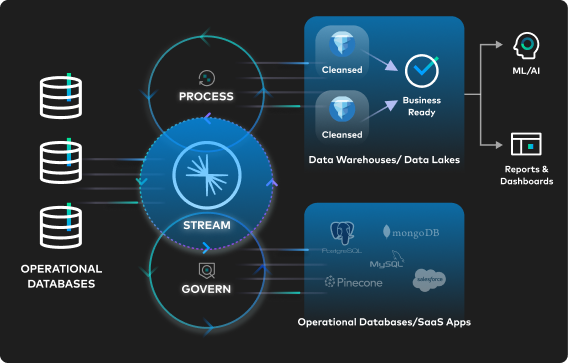

In data integration, “shifting left” refers to an approach where data processing and governance are performed closer to the source of data generation. By cleaning and processing the data earlier in the data lifecycle, you can build data products that give all downstream consumers—including cloud data warehouses, data lakes, and data lakehouses—a single source of well-defined and well-formatted data.

“Confluent helped us shift left on our data—giving teams full ownership of their data from source to output. Now it’s clean, validated, and production-ready upstream, reducing rework and accelerating delivery."

"Confluent Tableflow simplifies our data architecture, turning Kafka topics into trusted, analytics-ready tables in just a few clicks. We can now ensure a reliable data foundation for real-time customer insights and AI innovations."

Zazzle implemented Confluentʼs fully-managed Flink offering to transform their largest data pipeline. By shifting stream processing earlier in the pipeline before writing to Google BigQuery, Zazzle reduced storage and computation costs while delivering more relevant product recommendations, directly impacting revenue.

“We have 40,000+ ETL jobs today. It’s chaos…shifting data governance left would be transformational for our organization.”

“[Data cleaning] is a pricey way of pushing it down to the Delta Lake. De-duplication within Confluent is a cheaper way of doing it. We can only do it once.”

“I love the vision of [shift-left analytics]. This is how we would make datasets more discoverable. I knew that Confluent had an integration with Alation but it's awesome to hear that [with Data Portal] you have other ways of enabling those capabilities”

Trends in Shift-Left-Analytics

Wiederverwendbare Datenprodukte erstellen mit einem Shift-Left-Ansatz

Jetzt alles über Shift-Left-Analytics erfahren und wie dieser einfache, aber wirkungsvolle Ansatz zur Datenintegration moderne Unternehmen bei der Innovation unterstützt.

Show Me How: Shift Left Processing From Data Warehouses

Watch now

How to Optimize Data Ingestion Into Lakehouses & Warehouses

Get the guide

Tableflow Is GA: Unifying Apache Kafka® Topics & Apache Iceberg™️ Tables

Read blog

Conquer Your Data Mess With Universal Data Products

Download ebookDaten-Streaming-Projekte beschleunigen mithilfe unserer Partner

Wir arbeiten mit unserem umfangreichen Partner-Ökosystem zusammen, um es Kunden zu erleichtern, unternehmensweit hochwertige Datenprodukte zu entwickeln, darauf zuzugreifen, sie zu entdecken und zu teilen. Jetzt herausfinden, wie innovative Unternehmen wie Notion, Citizens Bank und DISH Wireless die Daten-Streaming-Plattform sowie unsere nativen Cloud-, Software- und Serviceintegrationen nutzen, um die Datenverarbeitung und Governance nach links zu verschieben und den Wert ihrer Daten zu maximieren.

Maximize Your Data Warehouses in 4 Steps

Maximize your data warehouses and data lakehouses by feeding them fresh trustworthy data. It all starts when you have a complete data streaming platform that lets you stream, connect, govern, and process your data (and materialize it in open table formats) no matter where it lives.

Learn how Confluent can help your organization shift left and maximize the value of your data warehouse and data lake workloads. Connect with us today to learn how to adopt shift-left architectures and accelerate your analytics and AI use cases.